Foto von Natalie Adams

Hinweis der Redaktion: Seit Februar 2024 veröffentlicht NewsGuard statt dem Misinformation Monitor nun Reality Check, einem englischen wöchentlichen Newsletter über Fehlinformationen und Nachrichtenmedien im Internet. Erfahren Sie mehr und abonnieren Sie ihn hier auf Substack.

"Verifizierte" X-Accounts mit blauem Haken produzieren 74 Prozent der auf der Plattform am häufigsten verbreiteten falschen oder unbelegten Behauptungen im Zusammenhang mit dem Israel-Hamas-Krieg

Eine NewsGuard-Analyse hat ergeben, dass "verifizierte" Accounts auf X in großem Umfang Falschinformationen über den Israel-Hamas-Krieg verbreiten. Die Konten tragen ein blaues Häkchen – das Symbol, das bei X die Verifizierung eines Accounts kennzeichnet, tatsächlich aber nichts verifiziert.

Von Jack Brewster, Sam Howard und Becca Schimmel | Veröffentlicht am 19. Oktober 2023

Nahezu drei Viertel der am meisten geteilten und gelikten Beiträge auf X, die Fehlinformationen über den Krieg zwischen Israel und der Hamas verbreiten, stammen von “verifizierten” X-Accounts. Das ergab eine Analyse von NewsGuard.

Im März 2023 änderte der Eigentümer von X, Elon Musk, das Verifizierungssystem der Plattform. Gegen eine Gebühr von 8 Dollar (in Deutschland: 9,52 €) pro Monat erhalten Nutzer:innen ein blaues Häkchen auf ihrem Profil und ihre Beiträge werden durch den Algorithmus der Plattform priorisiert angezeigt. Das bedeutet, dass sie unter den Replies der Nutzer:innen und in den Suchergebnissen weiter oben und an prominenter Stelle erscheinen. Diese Entscheidung erwies sich als Segen für Akteure mit schlechten Absichten, die Falschinformationen über den Krieg zwischen Israel und der Hamas verbreiten. Für den Preis einer Kinokarte erhalten diese Accounts die zusätzliche Glaubwürdigkeit, die mit dem ursprünglich prestigeträchtigen blauen Haken verbunden war, und können so ein größeres Publikum auf der Plattform erreichen.

In der ersten Woche des Konflikts (7. bis 14. Oktober) analysierte NewsGuard die 250 Beiträge mit den höchsten Online-Interaktionen (Likes, Reposts, Replies und Bookmarks), die mindestens eine von zehn prominenten falschen oder unbewiesenen Behauptungen über den Krieg verbreiteten. Die Falschbehauptungen stammen aus NewsGuards Misinformation-Fingerprints, einer Datenbank mit detaillierten Widerlegungen zu viralen Falschaussagen. Die Ergebnisse zeigen, dass 186 dieser 250 Beiträge – 74 Prozent – von Accounts gepostet wurden, die durch X verifiziert wurden.

Hier sind die 10 falschen oder unbelegten Behauptungen, die von NewsGuard identifiziert und von diesen verifizierten Konten verbreitet wurden:

- Die Ukraine verkaufte Waffen an die Hamas

- Israel hat seit 2008 33.000 palästinensische Kinder getötet

- Ein Video zeigt israelische und palästinensische Kinder in Käfigen

- Ein Video zeigt hochrangige israelische Beamte, die von der Hamas gefangen genommen wurden

- Die orthodoxe Kirche des Heiligen Porphyrios in Gaza wurde durch israelische Bombenangriffe zerstört

- Ein Video zeigt Hamas-Kämpfer, die die Entführung eines israelischen Kleinkindes feiern

- CNN inszenierte Aufnahmen seiner Nachrichtencrew bei einem Angriff in Israel

- Aus einem Memo des Weißen Hauses geht hervor, dass die USA 8 Milliarden Dollar an Militärhilfe für Israel genehmigten

- Israel inszenierte den Tod eines Kindes, das durch einen Hamas-Angriff getötet worden sein soll

- Der Hamas-Terroranschlag war eine “False Flag Aktion”, die von Israel oder dem Westen durchgeführt wurde

Die Beiträge, die diese Falschbehauptungen verbreiten, erhielten insgesamt 1.349.979 Online-Interaktionen und wurden in nur einer Woche weltweit mehr als 100 Millionen Mal angeschaut.

Angesichts der Kritik, dass die weitreichenden Änderungen zu einer Zunahme von Falschinformationen auf X geführt haben, verweist Musk oft auf die von der X-Community betriebene Faktencheck-Funktion “Community Notes”. NewsGuard stellte jedoch fest, dass nur 79 der 250 Beiträge, die Falschinformationen über den Krieg verbreiteten, von der Plattform mit einer Community-Note gekennzeichnet wurden. Das bedeutet, dass ein Hinweis nur in etwa 32 Prozent der Fälle unter Falschaussagen auf der Plattform erschien.

NewsGuard hat darüber hinaus auch falsche oder unbegründete Aussagen über den Krieg gesammelt, die auf Facebook, Instagram, TikTok, Telegram und durch andere Quellen verbreitet werden. Für diese Untersuchung konzentrierten sich NewsGuards Analyst:innen jedoch auf X, da es offenbar die einzige Plattform ist, die öffentlich bekannt gegeben hat, Beiträge weniger zu moderieren als vor der Übernahme durch Musk.

NewsGuard stellte außerdem fest, dass die meisten Falschbehauptungen im Zusammenhang mit dem Israel-Hamas-Krieg anscheinend zuerst auf X viral gingen, bevor sie auf anderen Plattformen wie TikTok und Instagram erschienen. Als Reaktion auf NewsGuards per E-Mail gestellte Fragen zu den Erkenntnissen der Recherche schickte das Presseteam von X eine automatisierte Antwort: “Momentan ausgelastet, bitte versuchen Sie es später erneut.”

Was ist X Premium?

Vor Elon Musks Übernahme von X (damals Twitter) wurden Nutzer:innen auf der Grundlage von “Authentizität, Bekanntheit und Aktivität” verifiziert. Seit der Einführung des blauen Hakens bezeichnet die Plattform diese Kennzeichnungen als “Legacy”-Verifizierung.

Heute müssen Nutzer:innen nicht länger “bekannt” sein, um das “blaue Häkchen” zu erhalten. Um auf X verifiziert zu werden, zahlen sie lediglich eine Gebühr von 8 Dollar, geben eine Telefonnummer an und fügen ein Profilbild hinzu (X schreibt dabei nicht vor, dass es sich um das Foto der Kontoinhaber:innen oder einer realen Person handeln muss). Accounts müssen außerdem bestätigen, dass sie “die Identität von Einzelpersonen, Gruppen oder Organisationen nicht missbrauchen” oder “Spam” verbreiten, heißt es im X-Help Center. X gibt an, ein blaues Häkchen erscheine für einen Account, sobald das X-Team “den Premium-Account überprüft und festgestellt hat, dass er den Anforderungen [der Plattform] entspricht”.

X gibt keine Auskunft darüber, wie oder ob es Anträge auf Verifizierung prüft. Die Plattform verlangt zudem nicht, dass ein echter Name auf dem Konto angegeben wird.

Die genauen Einzelheiten darüber, wie X die Position eines Beitrags in den Replies und in den Suchergebnissen der Nutzer:innen erhöht oder senkt, sind nicht bekannt. Die Analyse von NewsGuard deutet jedoch darauf hin, dass der algorithmische Boost, den Premium-Accounts mit einem blauen Häckchen von der Plattform erhalten, wichtig, wenn nicht sogar entscheidend dafür ist, dass Beiträge viral gehen.

Tatsächlich waren X Premium-Accounts maßgeblich an der Verbreitung der von NewsGuard ermittelten Falschbehauptungen über den Krieg beteiligt. Von den Beiträgen, die das meist verbreitetste, von NewsGuard identifizierte Narrativ enthielten – nämlich, dass die Ukraine Waffen an die Hamas verkauft hat – kamen 24 der 25 Beiträge von X Premium-Konten. Bei der zweithäufigsten Falschbehauptung – CNN habe Aufnahmen eines Angriffs auf eine ihrer Crews gefälscht – wurden 23 von 25 Beiträge von Konten mit dem blauen Häkchen gepostet.

Die von X verifizierten Falschinformations-Superspreader im Israel-Hamas-Krieg

NewsGuard hat sieben Accounts identifiziert, die mindestens zwei der am weitesten verbreiteten Falschbehauptungen über den Krieg geteilt haben. Alle waren von X verifiziert.

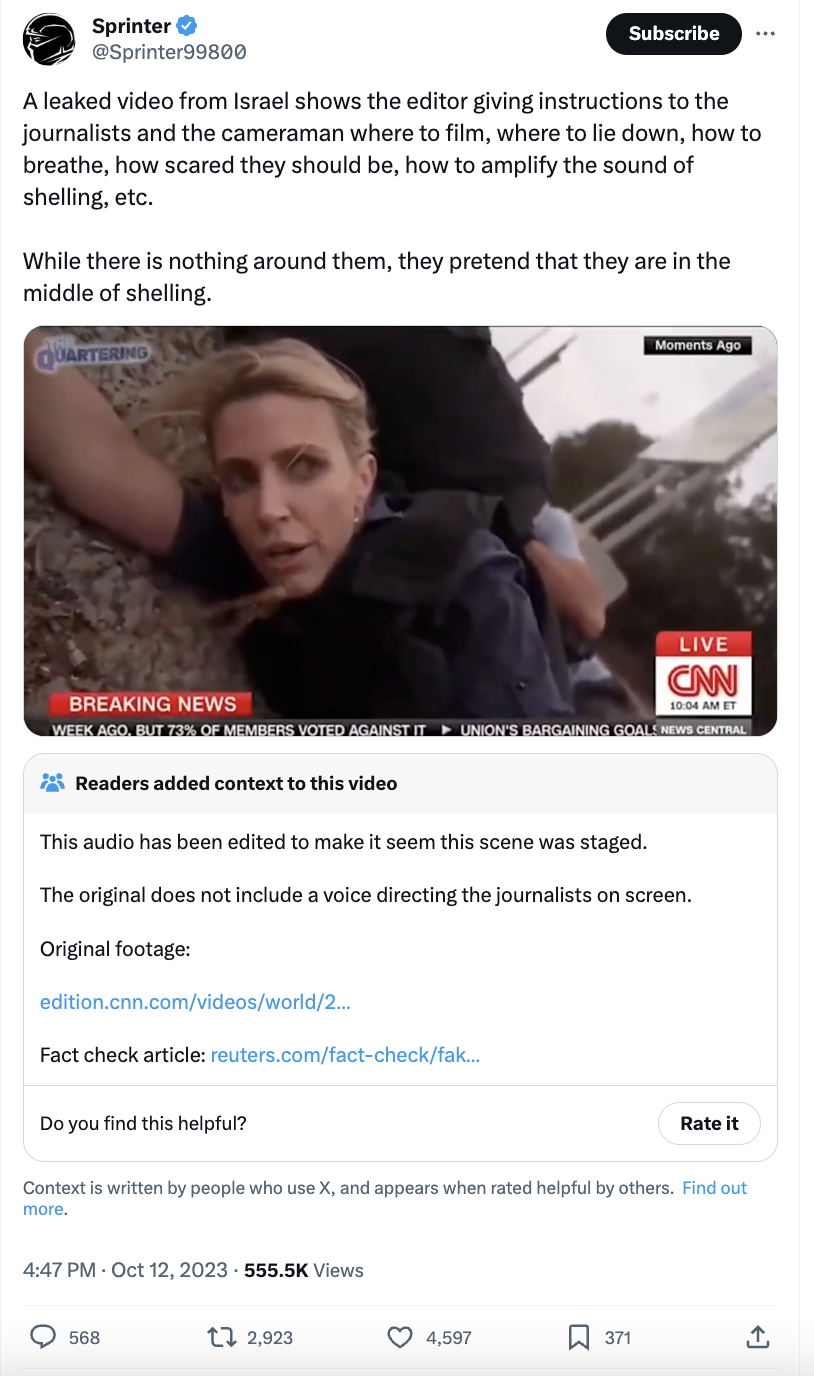

Zum Beispiel hat der von X verifizierte Nutzer @Sprinter99800, ein anonymer Account mit mehr als 361.000 Followers, fünf verschiedene kriegsbezogene Falschinformationen verbreitet. Dazu gehörten die zwei Behauptungen, ein manipuliertes Video zeige israelische Beamte, die von der Hamas gefangen genommen wurden, und CNN Aufnahmen eines Angriffs auf eines seiner Nachrichtenteams seien inszeniert. Laut der von Voice of America (ein von der US-Regierung finanzierter Radiosender) betriebenen Webseite Polygraph.Info wurde das Konto im Jahr 2022 aus unbekannten Gründen von Twitter gesperrt und nach Musks Übernahme der Plattform wieder zugelassen. Im September 2023, einen Monat vor Beginn des Krieges zwischen Israel und der Hamas, wurde das Konto mit dem blauen Haken verifiziert.

Insgesamt wurden die Beiträge von @Sprinter99800 fast 3 Millionen Mal aufgerufen.

“Ein geleaktes Video aus Israel zeigt den [CNN]-Redakteur, der den Journalisten und dem Kameramann Anweisungen gibt, wo sie filmen sollen, wo sie sich hinlegen sollen, wie sie atmen sollen, wie verängstigt sie sein sollen, wie sie die Geräusche des Beschusses verstärken sollen, usw.” schrieb @Sprinter99800 und verlinkte auf ein Video, das angeblich zeigen soll, wie CNN Aufnahmen eines Raketenangriffs in Israel inszeniert. “Während um sie herum nichts zu sehen ist, tun sie so, als wären sie inmitten von Beschuss.” Tatsächlich wurde dem Video ein Voiceover hinzugefügt, um den Eindruck zu erwecken, dass die Szene inszeniert wurde.

Der Beitrag, unter dem eine Community Note (korrekterweise) darauf hinwies, dass der Ton des angehängten Videos manipuliert wurde, erzielte bis zum 14. Oktober mehr als 8.100 Interaktionen (Likes, Shares, Antworten) und wurde 550.000 Mal angesehen.

Vor dem Krieg zwischen Israel und der Hamas verbreitete dieser Account bereits andere Falschbehauptungen, die von NewsGuard identifiziert wurden, darunter die Behauptung, dass der Leibwächter des ukrainischen Präsidenten Wolodymyr Selenskyi eine Schlägerei unter Alkoholeinfluss in New York begonnen habe, und dass der ukrainische Verteidigungsminister Kanada aufgefordert habe, 30.000 Kanadier zum Kampf gegen Russland zu mobilisieren.

Laura Loomer, eine weitere X-verifizierte Nutzerin und ehemalige Project Veritas-Reporterin, die 2020 und 2022 erfolglos als republikanische Kongresskandidatin in Florida antrat, verbreitete drei kriegsbezogene Falschaussagen, darunter die Behauptung, dass die USA 8 Milliarden Dollar an Militärhilfe an Israel geschickt hätten. Ihr Beitrag vom 7. Oktober, der diese Information enthielt, wurde bis zum 14. Oktober 360.000 Mal aufgerufen.

Der verifizierte Account @ShadowofEzra, der schon früher Verschwörungstheorien verbreitet hat, darunter auch, dass die Ukraine ein “offener Hafen für diejenigen ist, die sich dem Kindersexhandel verschrieben haben”, hat zwei Falschbehauptungen im Zusammenhang mit dem Krieg verbreitet. Zudem verfasste er fünf der am häufigsten geteilten Posts, die behaupteten, dass der Angriff auf Israel eine “False Flag Aktion” war.

Am 11. Oktober postete @ShadowofEzra: “False Flag: Die Hamas ist eine Erfindung der israelischen Regierung, und sie haben diese Anschläge geplant und zugelassen, um Unterstützung für einen Massenvölkermord zu gewinnen, der wahrscheinlich zum Dritten Weltkrieg führen wird.” Der Beitrag wurde bis zum 14. Oktober 292.000 Mal aufgerufen und 7.350 Mal geteilt, geliked und kommentiert. (“False Flag” ist ein Angriff, bei dem der Anschein erweckt wird, dass er von einer anderen Partei verübt wurde und nicht von dem Akteur, der den Anschlag tatsächlich ausgeführt hat).

ShadowofEzra trat Twitter im Dezember 2022 bei und zahlt seit September 2023, wie @Sprinter99800, 8 Dollar, um X Premium-Nutzer zu sein.

Fast 70% der Beiträge mit Falschbehauptungen enthalten keine Community Notes

X verlässt sich unter Elon Musks Eigentümerschaft stark auf Faktenchecks aus der Community von X-Nutzer:innen, anstatt auf professionelle Faktenchecker:innen oder andere unabhängige journalistische Bemühungen. In der ersten Woche des Israel-Hamas-Krieges – so die Analyse von NewsGuard – finden Faktenchecks in Form der Community Notes jedoch nur inkonsistent Anwendung bei führenden Falschbehauptungen über den Krieg. Tatsächlich fehlen sie bei 68 Prozent der Beiträge mit widerlegbaren Falschinformationen.

Ein Beispiel dafür, wie die Community Notes auf X gut funktionieren können, zeigen Beiträge mit der falschen Behauptung, ein Video zeige Hamas-Kämpfer mit einem entführten israelischen Kleinkind. 21 der 25 Top-Beiträge, die NewsGuard fand, enthielten Faktenchecks und Kontext in der Form einer Community Note.

Im Gegensatz dazu fand sich eine Community Note nur bei einem der 25 Top-Beiträge mit der unbelegten Behauptung, Israel habe seit 2008 33.000 palästinensische Kinder getötet. Bei der Falschaussage, dass ein Memo des Weißen Hauses aufgedeckt habe, dass die USA 8 Milliarden Dollar an Militärhilfe an Israel schicken, waren nur vier der 25 Top-Beiträge mit einer entsprechenden Community Note versehen.

Und nur eine (nicht im richtigen Zusammenhange stehende) Community Note fand sich unter den 25 Top-Beiträgen, die die unbegründete Behauptung aufstellten, dass der erste Angriff der Hamas auf Israel eine “False Flag Aktion” war. In einem dieser Beiträge hieß es: “BREAKING NEWS: Es gibt jetzt Berichte über einen IDF-Geheimdienst Soldaten Insider, der behauptet, dass der Angriff auf Israel eine ‘False Flag’ war, um einen ‘Heiligen Krieg’ zu beginnen und eine ‘Weltregierung’ einzuführen.”

Als Quelle für diese Informationen nannte der Beitrag GlobalResearch.ca, eine Webseite, die schon vor dem Krieg zwischen Israel und der Hamas Verschwörungstheorien und pro-russische Propaganda verbreitet hatte. Sie erhält ein NewsGuard Glaubwürdigkeits-Rating von 17,5/100.

Methodik

Im Oktober 2023, während der ersten Woche des Israel-Hamas-Krieges (7. bis 14. Oktober), analysierte NewsGuard für jede der 10 oben genannten Falschbehauptungen über den Krieg die 25 Beiträge auf X mit den meisten Online-Interaktionen. Für diesen Bericht definierte NewsGuard Online-Interaktionen als die Gesamtzahl der Reposts, Likes, Bookmarks und Replies, die jeder Beitrag erhielt. Es ist wichtig zu beachten, dass X Premium-Abonnent:innen die Möglichkeit haben, das Häkchen, das ihre Verifizierung anzeigt, zu “verbergen”. Daher ist es möglich, dass die von NewsGuard durchgeführte Analyse der X Premium-Accounts die Gesamtzahl unterschätzt, da einige Premium-Nutzer:innen möglicherweise ihr Häkchen ausblenden.

Anmerkung der Redaktion: Am 20. Oktober änderte NewsGuard eine frühere Version dieses Berichts, in der es hieß, dass Beiträge von X-Premium-Konten algorithmisch in den “Feeds” der Nutzer:innen hervorgehoben werden, die NewsGuard als Beiträge definierte, die auf einer bestimmten X-Seite in aufeinanderfolgender Reihenfolge erscheinen. Nachdem NewsGuard diesen Bericht veröffentlicht hatte, kontaktierte X NewsGuard und teilte mit, dass Beiträge von X-Premium-Konten in der Tat in den Suchergebnissen und unter den Replies der Nutzer:innen hervorgehoben werden, nicht aber in den Hompage-“Feeds” der Nutzer:innen. Daher hat NewsGuard diesen Bericht aktualisiert, um zu präzisieren, dass die Beiträge von X-Premium-Konten unter den Replies und Suchergebnissen hervorgehoben werden.