Foto von Natalie Adams

Hinweis der Redaktion: Seit Februar 2024 veröffentlicht NewsGuard statt dem Misinformation Monitor nun Reality Check, einem englischen wöchentlichen Newsletter über Fehlinformationen und Nachrichtenmedien im Internet. Erfahren Sie mehr und abonnieren Sie ihn hier auf Substack.

Große Gefahr für Marken: X und Accounts, die Fehlinformationen verbreiten, teilen sich die Werbegelder aus falschen oder grob irreführenden Behauptungen über den Israel-Hamas Krieg

NewsGuard hat Anzeigen von 86 großen Werbetreibenden – darunter führende Unternehmen, Bildungseinrichtungen, Regierungen und gemeinnützige Organisationen – in viralen Beiträgen mit Fehlinformationen über den Krieg zwischen Israel und Hamas gefunden. Diese erreichten insgesamt 92 Millionen X-Nutzer:innen.

Von Jack Brewster, Coalter Palmer und Nikita Vashisth | Veröffentlicht am 22. November 2023

Mit Beiträgen von Natalie Adams, John Gregory, Sam Howard, McKenzie Sadeghi und Roberta Schmid

Programmatische Werbung auf X, die zahlreiche große Unternehmen, Regierungen, Bildungseinrichtungen und gemeinnützige Organisationen schalten, wird in den Feeds und direkt unter viralen Beiträgen angezeigt, die falsche oder grob irreführende Behauptungen über den Krieg zwischen Israel und Hamas verbreiten. Das ergab eine Analyse von NewsGuard. Gemäß den Richtlinien eines neuen Programms zur Aufteilung der Werbeeinnahmen, das X für seine “Creators” eingeführt hat, geht ein Teil der Werbeeinnahmen offenbar auch an diese Konten, die Superspreader von Fehlinformationen sind.

Zwischen dem 13. und 22. November 2023 untersuchten NewsGuards Analyst:innen programmatische Anzeigen, die in den Feeds unter 30 viralen Posts erschienen. Alle verbreiteten zudem falsche oder irreführende Informationen über den Krieg. (Programmatische Werbung wird mithilfe von Algorithmen geschaltet, die digitale Anzeigen gezielt Online-Nutzer:innen liefern. Marken können in der Regel nicht entscheiden, wo ihre programmatischen Anzeigen laufen, und wissen daher meist nicht, in welchem Umfeld sie erscheinen.

Die hier untersuchten 30 viralen Posts wurden von zehn der schlimmsten Verbreitern von Fehlinformationen über den Israel-Hamas Krieg gepostet. Alle Konten wurden zuvor bereits von NewsGuard als wiederholte Verbreiter von Fehlinformationen über den Konflikt identifiziert. Nach Angaben von X haben die 30 Posts insgesamt über 92 Millionen Nutzer:innen erreicht und im Durchschnitt wurde jeder Post von 3 Millionen Menschen gesehen.

Eine Liste der berücksichtigten 30 Posts und 10 Konten finden Sie hier.

In den 30 Posts wurden einige der gröbsten falschen oder irreführenden Behauptungen über den Krieg aufgestellt, die NewsGuard in seiner “Misinformation Fingerprints”-Datenbank katalogisiert hat. Dazu gehören unter anderem die Behauptung, der Hamas-Angriff auf Israel am 7. Oktober 2023 sei ein “false flag attack”, also inszeniert, gewesen. Sowie die Behauptung, der amerikanische Sender CNN habe Aufnahmen eines Raketenangriffs auf ein Nachrichtenteam in Israel im Oktober 2023 inszeniert. Die Hälfte der Posts wurde von Community Notes, X’s Crowd-Source-Funktion zur Überprüfung von Fakten, mit einem Faktencheck gekennzeichnet. Dadurch sollen die Beiträge gemäß der X-Richtlinie von Werbeeinnahmen ausgenommen werden. Die andere Hälfte der Posts hatte keinen Faktencheck. Unabhängig davon, fand NewsGuard in allen Beiträgen Werbung für große Marken wie etwa Microsoft, Airbnb, Pizza Hut, Paramount und Oracle.

Insgesamt hat NewsGuard 200 Anzeigen von 86 Unternehmen, gemeinnützigen Organisationen, Bildungseinrichtungen und Regierungen gefunden, die in den Feeds unter 24 der 30 Posts mit falschen oder irreführenden Behauptungen über den Israel-Hamas Krieg erschienen. Die anderen sechs Posts enthielten keine Werbung. (Auf X erscheinen Anzeigen als Posts, die Nutzer:innen in den Feeds angezeigt werden.) Die oben genannten Anzeigen wurden NewsGuards Analyst:innen in fünf Ländern in ihren eigenen X-Konten angezeigt: neben Deutschland, sind das auch die USA, Großbritannien, Frankreich und Italien.

Erst vor kurzem zogen Apple, Disney und IBM ihre Anzeigen von X zurück, nachdem der Eigentümer Elon Musk einen antisemitischen Beitrag auf der Plattform befürwortet hatte. Auf NewsGuards Anfrage per E-Mail reagierte die Pressestelle von X mit einer automatischen Antwort: “Gerade beschäftigt, bitte schauen Sie später wieder vorbei”.

Am 21. November, nachdem NewsGuard sich mit der Analyse an X gewandt hatte, postete Musk: “X Corp wird alle Einnahmen aus Werbung und Abonnements im Zusammenhang mit dem Krieg in Gaza an Krankenhäuser in Israel und das Rote Kreuz/Halbmond in Gaza spenden.” Es ist nicht klar, was Musk mit “Einnahmen aus Werbung und Abonnements im Zusammenhang mit dem Krieg in Gaza” meint und er äußerte sich nicht dazu, dass viele oder alle dieser Kontoinhaber:innen durch die Verbreitung von Fehlinformationen auf X Geld verdienen. Auf eine Anfrage von NewsGuard am 22. November, in der um eine Klarstellung zu Musks Ankündigung gebeten wurde, antwortete die Pressestelle von X erneut mit einer automatischen Antwort.

Oracle, Pizza Hut und Anker: Monetarisierung von Fehlinformationen anhand einer “verbrannten Babyleiche”

Am 29. Oktober 2023 schrieb Elon Musk, dass Kommentator:innen, deren Beiträge von Community Notes mit Faktenchecks markiert wurden, nicht berechtigt seien, an den Werbeeinnahmen für diesen Beitrag zu verdienen. In 14 der 15 Posts, die kriegsbezogene Fehlinformationen und keinen Faktencheck enthielten, fand NewsGuard jedoch weiterhin Werbung. Darunter für 70 verschiedene bekannte Unternehmen.

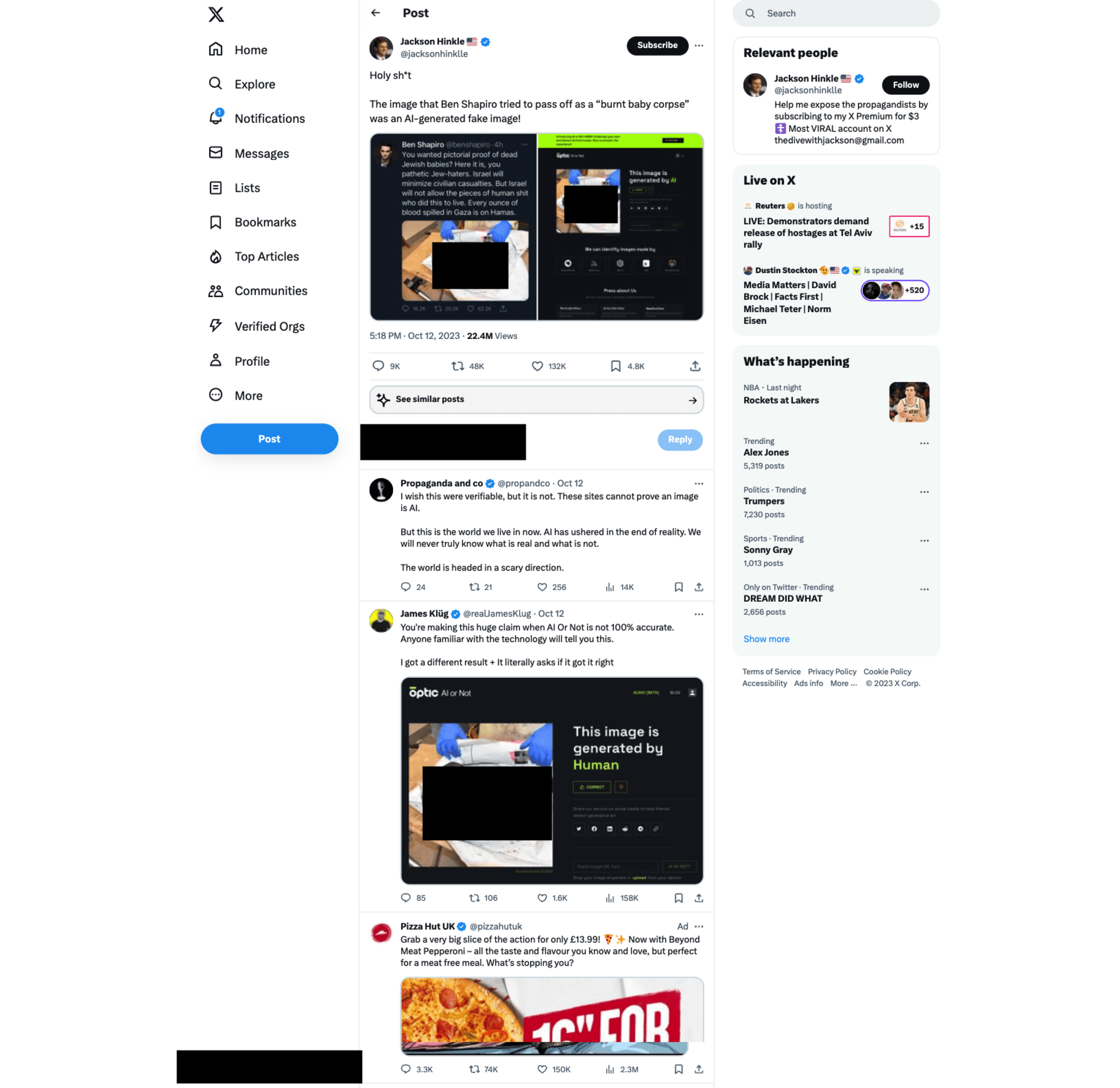

NewsGuard fand beispielsweise 22 Anzeigen für große Organisationen in drei Posts von Jackson Hinkle, ein Kommentator, der sich selbst als “amerikanischer konservativer Marxist-Leninist” bezeichnet und zahlreiche Falschinformationen über den Krieg verbreitet hat. So auch die Beiträge, die in dieser Analyse von ihm berücksichtigt wurden, die allesamt keinen Faktencheck-Hinweis beinhalteten.

Unter einem von Hinkle am 12. Oktober 2023 geposteten Beitrag wurde NewsGuards Analyst:innen unter anderem Werbung für Oracle, Pizza Hut und Anker angezeigt. In dem Post behauptete Hinkle fälschlicherweise, dass Ben Shapiro (Podcast-Moderator von Daily Wire), künstliche Intelligenz (KI) eingesetzt hätte, um das Bild eines Kindes zu erstellen, das von der Hamas getötet wurde. Der Post wurde bis zum 20. November 22 Millionen Mal aufgerufen.

“Holy sh*t”, schrieb Hinkle in dem Post. “Das Bild, das Ben Shapiro versucht hat als ‘verbrannte Babyleiche’ zu verkaufen, war eine KI-generierte Fälschung!” Es gibt jedoch keine Belege dafür, dass das Foto, das zuerst von der israelischen Regierung verbreitet wurde, mit Hilfe von KI erstellt wurde. Hany Farid, Professor an der University of Berkeley’s School of Information, sagte in einem Artikel der Tech-Nachrichtenseite 404 Media, dass das Bild des Babys “keine Anzeichen dafür aufweist, dass es von KI erstellt wurde”. Und fügte hinzu: “Die strukturelle Konsistenz, die akkuraten Schatten, das Fehlen von Artefakten, die wir normalerweise bei KI sehen – das bringt mich zu der Annahme, dass es nicht einmal teilweise von KI erzeugt wurde.” Der X-Post erhielt bis zum 20. November keinen Faktencheck, was bedeutet, dass Hinkle wahrscheinlich Anspruch auf Werbeeinnahmen hatte.

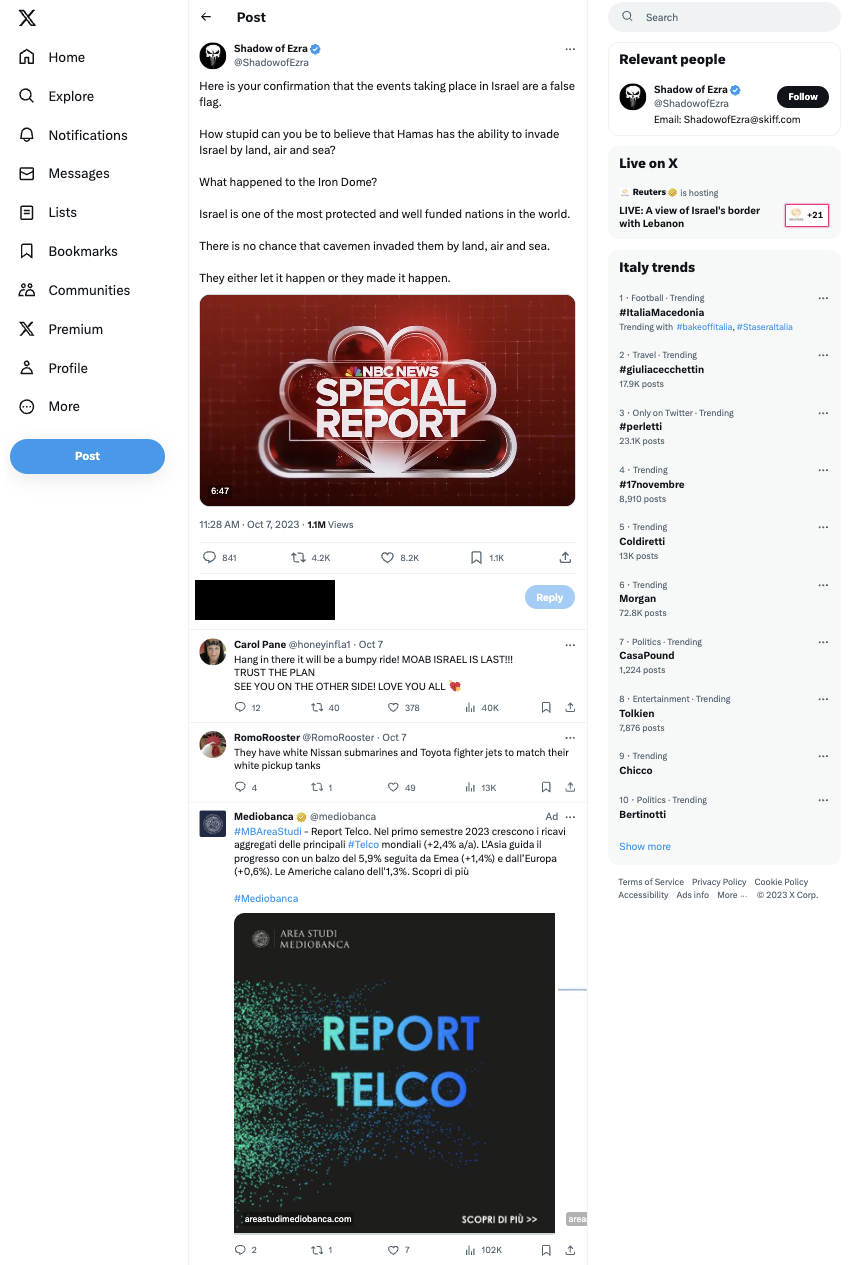

NewsGuard fand außerdem Anzeigen für 36 große Werbetreibende (einige Organisationen erschienen mehr als einmal) in drei Posts des rechtsextremen Kommentators @ShadowofEzra, der ebenfalls Fehlinformationen über den Krieg verbreitete. Keiner der drei Posts enthielt einen Faktencheck-Hinweis.

In einem der drei Posts, der die unbegründete Behauptung aufstellte, der Angriff der Hamas auf Israel am 7. Oktober 2023 sei ein “false flag” gewesen, wurden NewsGuard Anzeigen für Paramount, Microsoft, das Robotikunternehmen ABB Robotics, die italienische Investmentbank Mediobanca und das Rohstoffunternehmen Sappi Group angezeigt. “Hier ist eure Bestätigung, dass die Ereignisse in Israel ein ‘false flag’ sind”, hieß es in dem Post von @ShadowofEzra. “Wie dumm kann man sein, zu glauben, dass Hamas in der Lage ist, Israel auf dem Land-, Luft- und Seeweg anzugreifen?… Die haben das entweder geschehen lassen oder sie haben dafür gesorgt, dass es passiert.” Der Beitrag wurde bis zum 21. November 2023 1,1 Millionen Mal aufgerufen. (Am 17. November kündigte Paramount an, dass das Unternehmen keine Werbung mehr auf X schalten würde.)

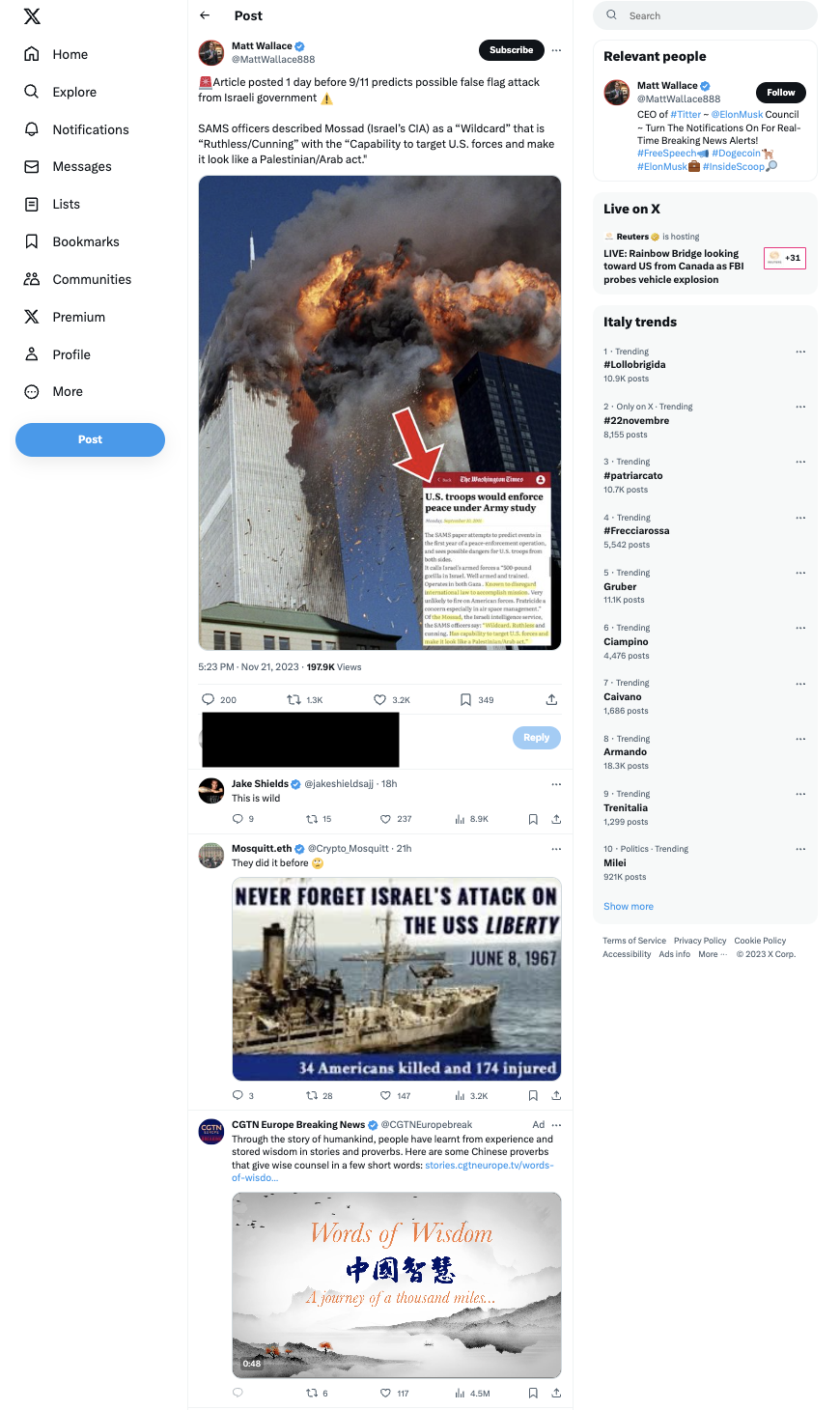

In ähnlicher Weise erschienen Anzeigen für Airbnb, die Virgin Group, das taiwanesische Technologieunternehmen Asus, das konservative Medienunternehmen The Dispatch und das milliardenschwere schwedische Hygieneunternehmen Essity neben einem Beitrag des konservativen Kommentators Matt Wallace, der unbelegterweise behauptete, der Angriff der Hamas auf Israel sei ein “Inside-Job” gewesen. Der Beitrag erhielt keinen Faktencheck und wurde bis zum 21. November 1,2 Millionen Mal aufgerufen.

Kontoinhaber:innen müssen drei spezifische Kriterien erfüllen, um für die Beteiligung an den Werbeeinnahmen von X in Frage zu kommen: Sie müssen 1) Abonnent:innen von X Premium sein (8$ pro Monat), 2) in den letzten drei Monaten mindestens fünf Millionen Impressionen über ihre Beiträge erzielt haben und 3) mindestens 500 Follower:innen haben. Jeder der 10 Superspreader-Accounts, die NewsGuard untersucht hat, scheint diese Kriterien zu erfüllen.

Regierungen und gemeinnützige Organisationen finanzieren indirekt die Fehlinformationsmaschine des Israel-Hamas Kriegs.

Unter den 200 Anzeigen, die NewsGuard auf Superspreader-Posts mit kriegsbezogenen Fehlinformationen gefunden hat, waren 26 für regierungsnahe Organisationen – unter anderem staatliche Behörden, staatliche Unternehmen und staatlich geführte ausländische Medien.

So fand NewsGuard beispielsweise eine Anzeige für das FBI in einem Post von Jackson Hinkle vom 9. November 2023, in dem behauptet wurde, ein Video zeige einen israelischen Militärhubschrauber, der auf seine eigenen Bürger:innen schieße. Der Beitrag enthielt keinen Faktencheck-Hinweis und wurde bis zum 20. November mehr als 1,7 Millionen Mal aufgerufen.

“ISRAEL GIBT ZU, dass sie mit APACHE ATTACK HELICOPTERN auf ihre EIGENEN ZIVILISTEN geschossen haben!” schrieb Hinkle in einem Beitrag, in dem er auf das Video verlinkte. Das Video zeigte jedoch israelische Flugzeuge, die Angriffe gegen die Hamas über dem Gazastreifen durchführten, so GeoConfirmed, eine Gruppe von Open-Source-Intelligence Analyst:innen.

Die Anzeige für das FBI, die unter Hinkles Post erschien, warb für die Arbeit des FBI zur Bekämpfung von Hassverbrechen. “Hassverbrechen schaden nicht nur den Opfern, sondern verbreiten auch Angst in ihren Communities”, hieß es in der Anzeige. “Das #FBI setzt sich für die Bekämpfung von Hassverbrechen und für Gerechtigkeit für Opfer ein.” NewsGuard hat dem FBI am 20. November zwei E-Mails und eine Nachricht über das Kontaktformular geschickt, um nach der Anzeige zu fragen. Und ob diese bewusst in diesem Umfeld geschaltet wurde. Eine FBI-Sprecherin lehnte eine Stellungnahme ab und verwies NewsGuard bei Fragen zur Platzierung von Anzeigen auf der Plattform an X.

Andere Anzeigen von staatlichen Stellen waren beispielsweise eine Anzeige für die staatliche Abu Dhabi National Oil Company, die unter einem Post erschien, in dem behauptet wurde, ein palästinensischer Blogger täusche Verletzungen aus dem Krieg vor. Eine Anzeige des taiwanesischen Kulturministeriums erschien unter einem Post, in dem fälschlicherweise behauptet wurde, ein Video zeige, wie Israel auf seine eigenen Zivilisten schieße. Und eine Anzeige des chinesischen Regierungssender China Global Television Network (CGTN) erschien unter einem Post von Matt Wallace, in dem behauptet wurde, 9/11 sei ein “false-flag-Angriff [der] israelischen Regierung” gewesen. Keiner der Beiträge enthielt Faktenchecks (Stand 21. November).

NewsGuard fand auch Anzeigen für eine Reihe von gemeinnützigen Organisationen und Bildungseinrichtungen unter Posts, die Fehlinformationen über den Krieg verbreiten. So fand NewsGuard beispielsweise eine Anzeige für Clean Air Action Fund, eine gemeinnützige Organisation, die sich gegen Luftverschmutzung einsetzt. Die Anzeige erschien unter einem Post von @YosephHaddad, in dem fälschlicherweise behauptet wurde, dass CNN-Filmmaterial einen palästinensischen Krisendarsteller zeige. Der Post enthielt ebenfalls keinen Faktencheck-Hinweis und wurde bis zum 21. November mehr als 639.000 Mal aufgerufen. (NewsGuard wurde unter demselben Post auch eine Anzeige für das Danish National Genome Center, eine zum dänischen Gesundheitsministerium gehörende Agentur, angezeigt).

Unter dem bereits erwähnten Hinkle-Post, in dem behauptet wurde, dass ein Video zeige, wie Israel auf seine eigenen Bürger schieße, fand NewsGuard außerdem eine Anzeige der University of Baltimore — einer staatlichen Universität in Baltimore, Maryland.

Ein Post von @ShadowofEzra, in dem behauptet wurde, der Krieg sei eine “false flag”-Aktion, enthielt eine Anzeige für die Royal Society of Chemistry, eine gemeinnützige akademische Gesellschaft in Großbritannien mit dem Ziel, “die chemischen Wissenschaften zu fördern”. Der Post verlinkte auf ein CNN-Interview, in dem der Sprecher des Nationalen Sicherheitsrates, John Kirby, bei der Diskussion über den Hamas-Angriff auf Israel am 7. Oktober 2023 emotional wurde. “John Kirby beginnt live auf CNN zu weinen”, schrieb @ShadowofEzra dazu. “Brauchen Sie noch mehr Beweise, dass es eine false flag war?”

Methodologie

Zwischen dem 13. und 22. November 2023 analysierte NewsGuard 30 Posts, die Fehlinformationen über den Krieg verbreiteten. Diese wurden von 10 Konten gepostet, die zuvor von NewsGuard als Superspreader von Fehlinformationen über den Israel-Hamas Krieg identifiziert wurden. NewsGuard definiert “Superspreader von Fehlinformationen” als solche, die drei oder mehr falsche oder grob irreführende Behauptungen im Zusammenhang mit dem Krieg verbreitet haben und mehr als 100.000 Follower auf X haben. (Viele der Konten veröffentlichten weit mehr als drei falsche oder grob irreführende Behauptungen über den Krieg.)

Um das programmatische Anzeigenverhalten verschiedener Nutzer:innen zu simulieren, verwendete NewsGuard Virtual Private Networks (VPN) – ein Tool, mit dem Nutzer:innen ihren Standort im Netz ändern können – und aktualisierte die Seite jedes der 30 Posts regelmäßig. NewsGuards Team rief jeden Post in den verschiedenen Ländern auf — Deutschland, USA, Großbritannien, Frankreich und Italien — und aktualisierte die Seite maximal 25 Mal. NewsGuard scrollte so weit nach unten, dass der Feed maximal fünfmal “neu geladen” wurde, da nicht alle Antworten auf einen bestimmten Post auf dem Bildschirm des Posts angezeigt werden konnten.

Bei der Überprüfung der 10 Konten suchten die Analyst:innen nach Anzeigen, die im Antwortbereich von Beiträgen mit kriegsbezogenen Fehlinformationen erschienen und screenshotteten jede Anzeige.

X verklagte vor kurzem Media Matters for America aufgrund eines Artikels, den die progressive Advocacy-Gruppe über Anzeigen prominenter Marken veröffentlichte, die neben Konten mit extremistischen Inhalten erschienen waren. X behauptete in diesem Fall, dass Media Matters die Verbindung der Marken mit den extremistischen Inhalten künstlich hergestellt habe, indem es die ausgewählten X-Konten nur einer bestimmten Gruppe von großen Unternehmen sowie mehreren Konten mit extremistischen Inhalten folgen ließ. Dadurch sei ein “anorganisches” Szenario geschaffen worden, in dem die Anzeigen für diese Marken neben solchen Inhalten erscheinen und so “böswillig hergestellte Seite-an-Seite-Bilder” entstehen, hieß es in der Klage von X.

Die Methodik von NewsGuard unterschied sich maßgeblich von dieser Vorgehensweise in diesen Punkten:

- NewsGuard manipulierte die Stichprobe nicht, indem selektiv bestimmten Marken oder Konten gefolgt wurde. Stattdessen haben die Analyst:innen von NewsGuard virale Inhalte angeschaut, die ihnen auf der Plattform automatisch über ihre persönlichen X-Konten angezeigt wurden.

- Die von Media Matters for America analysierten Posts erhielten relativ wenige Impressionen. Wie bereits erwähnt, haben die 30 Posts, die NewsGuard analysiert hat, laut X-Daten insgesamt über 92 Millionen Zuschauer:innen erreicht. Im Durchschnitt wurde jeder Post von 3 Millionen Menschen gesehen.

- NewsGuard hat die Anzahl der Aktualisierungen jedes Posts in jedem analysierten Land (25) und das Scrollen zum Anzeigen des Feeds (fünf) begrenzt. (X zeigt nur eine begrenzte Anzahl von Antworten auf einen Post in einem bestimmten Feed an).