Image par Natalie Adams

Note de la rédaction : Depuis février 2024, la newsletter mensuelle de NewsGuard – appelée Misinformation Monitor – a laissé place à Reality Check, une newsletter hebdomadaire en anglais, sur les tendances de la mésinformation en ligne. Pour en savoir plus, et vous inscrire sur Substack, c’est par ici.

Risque pour les marques : comment X et les ‘super-propagateurs’ d’informations fausses ou manifestement trompeuses sur la guerre entre Israël et le Hamas se partagent les recettes de la publicité

NewsGuard a identifié des publicités pour 86 grands annonceurs — parmi lesquels des marques de premier plan, des institutions éducatives, des gouvernements et des associations — sur des posts viraux vus au total 92 millions de fois sur X (anciennement Twitter) et relayant des affirmations fausses ou manifestement trompeuses sur la guerre entre Israël et le Hamas.

Par Jack Brewster, Coalter Palmer et Nikita Vashisth | Publié le 23 novembre 2023

Avec la contribution de Natalie Adams, John Gregory, Sam Howard, McKenzie Sadeghi et Roberta Schmid

Sur X, des publicités programmatiques pour des dizaines de grandes marques, de gouvernements, d’institutions éducatives et d’organisations à but non lucratif s’affichent dans les flux figurant juste en-dessous de posts viraux diffusant des affirmations fausses ou manifestement trompeuses sur la guerre entre Israël et le Hamas, comme le montre une étude de NewsGuard. D’après les termes d’un nouveau programme de partage des recettes publicitaires que X a introduit pour ses “créateurs”, une partie des revenus publicitaires générés par ces organisations serait apparemment partagée avec ces “super-propagateurs” de mésinformation.

Du 13 au 22 novembre 2023, des analystes de NewsGuard ont examiné les publicités programmatiques apparaissant dans les flux affichés sous 30 posts viraux sur X contenant des informations fausses ou manifestement trompeuses au sujet de la guerre. Les publicités programmatiques sont diffusées par le biais d’algorithmes qui ciblent les lecteurs en ligne. Les marques ne choisissent généralement pas l’endroit où ces publicités programmatiques sont diffusées, et ignorent où elles apparaissent.

Ces 30 posts viraux ont été publiés par dix des pires colporteurs d’infox sur la guerre entre Israël et le Hamas identifiés sur X, dont les comptes avaient précédemment été repérés par NewsGuard comme ayant publié de manière répétée de la mésinformation sur le conflit. Ces 30 posts ont cumulé plus de 92 millions de vues, selon les données de X. En moyenne, chaque post a été vu 3 millions de fois.

Une liste des 30 posts et des 10 comptes utilisés dans l’analyse de NewsGuard est disponible ici.

Les 30 posts examinés relaient certaines des allégations les plus manifestement fausses ou trompeuses sur la guerre que NewsGuard avait précédemment démystifiées dans sa base de données appelée “Empreintes de la Mésinformation”, un catalogue recensant les principaux mythes propagés en ligne. Celles-ci comprennent l’affirmation selon laquelle l’attaque du Hamas contre Israël le 7 octobre 2023 était une opération sous “faux drapeau” (une opération menée avec de fausses insignes pour en faire porter la responsabilité à un ennemi), ou celle selon laquelle CNN aurait mis en scène des images d’une attaque à la roquette contre une équipe de journalistes en Israël en octobre 2023. La moitié des posts (15) ont été signalés par des “Notes de la Communauté”, une fonctionnalité de X proposant une vérification des faits réalisée collectivement par les utilisateurs de la plateforme, ce qui, en vertu de la politique de X, les rendrait inéligibles aux recettes publicitaires. Cependant, l’autre moitié ne comportait pas de note de la communauté. NewsGuard a repéré des publicités pour de grandes marques telles que Pizza Hut, Airbnb, Microsoft, Paramount et Oracle sur des posts avec et sans notes de la communauté (voir ci-dessous).

Au total, les analystes de NewsGuard ont identifié 200 publicités émanant de 86 grandes marques, organisations à but non lucratif, établissements d’enseignement et gouvernements qui sont apparues dans les flux figurant sous 24 des 30 posts contenant des affirmations fausses ou manifestement trompeuses sur la guerre entre Israël et le Hamas. Les six autres posts ne contenaient pas de publicités. (Sur X, les publicités apparaissent sous forme de “posts” qui sont présentés aux utilisateurs dans les flux de contenu). Ces publicités ont été présentées à des analystes de NewsGuard naviguant sur internet à l’aide de leurs propres comptes X dans cinq pays (les États-Unis, le Royaume-Uni, l’Allemagne, la France et l’Italie).

Le rapport de NewsGuard est publié après qu’Apple, Disney et IBM ont retiré leurs publicités de X après que son propriétaire Elon Musk a soutenu un message antisémite sur la plateforme. En réponse aux questions de NewsGuard envoyées par email au sujet de ces constats et des publicités apparaissant dans les flux sous les posts diffusant de fausses informations, l’équipe presse de X a envoyé une réponse automatisée disant en anglais : “Nous sommes occupés, merci de nous faire signe plus tard”.

Le 21 novembre, après que NewsGuard a contacté X au sujet de ce rapport, Elon Musk a posté un message sur X disant : “X Corp fera don de tous les revenus de la publicité et des abonnements associés à la guerre à Gaza aux hôpitaux en Israël et à la Croix-Rouge/au Croissant-Rouge à Gaza”. On ne sait pas exactement ce qu’Elon Musk entend par “revenus de la publicité et des abonnements associés à la guerre à Gaza”. En réponse à une requête de NewsGuard le 22 novembre sollicitant des éclaircissements sur l’annonce d’Elon Musk, le service de presse de X a de nouveau envoyé une réponse automatisée.

D’Oracle à Pizza Hut : la monétisation d’une infox sur un “cadavre de bébé brûlé”

Le 29 octobre 2023, Elon Musk a déclaré que les utilisateurs dont les posts ont été signalés par des notes de la communauté ne seraient pas autorisés à gagner de l’argent grâce aux publicités sur le post en question. Cependant, NewsGuard a trouvé des publicités pour 70 organisations majeures sur 14 des 15 posts diffusant des informations erronées sur la guerre qui ne faisaient pas l’objet d’une note de la communauté. Cela signifie que certains des pires colporteurs d’infox sur la guerre ont probablement pu percevoir des recettes publicitaires provenant de grandes organisations.

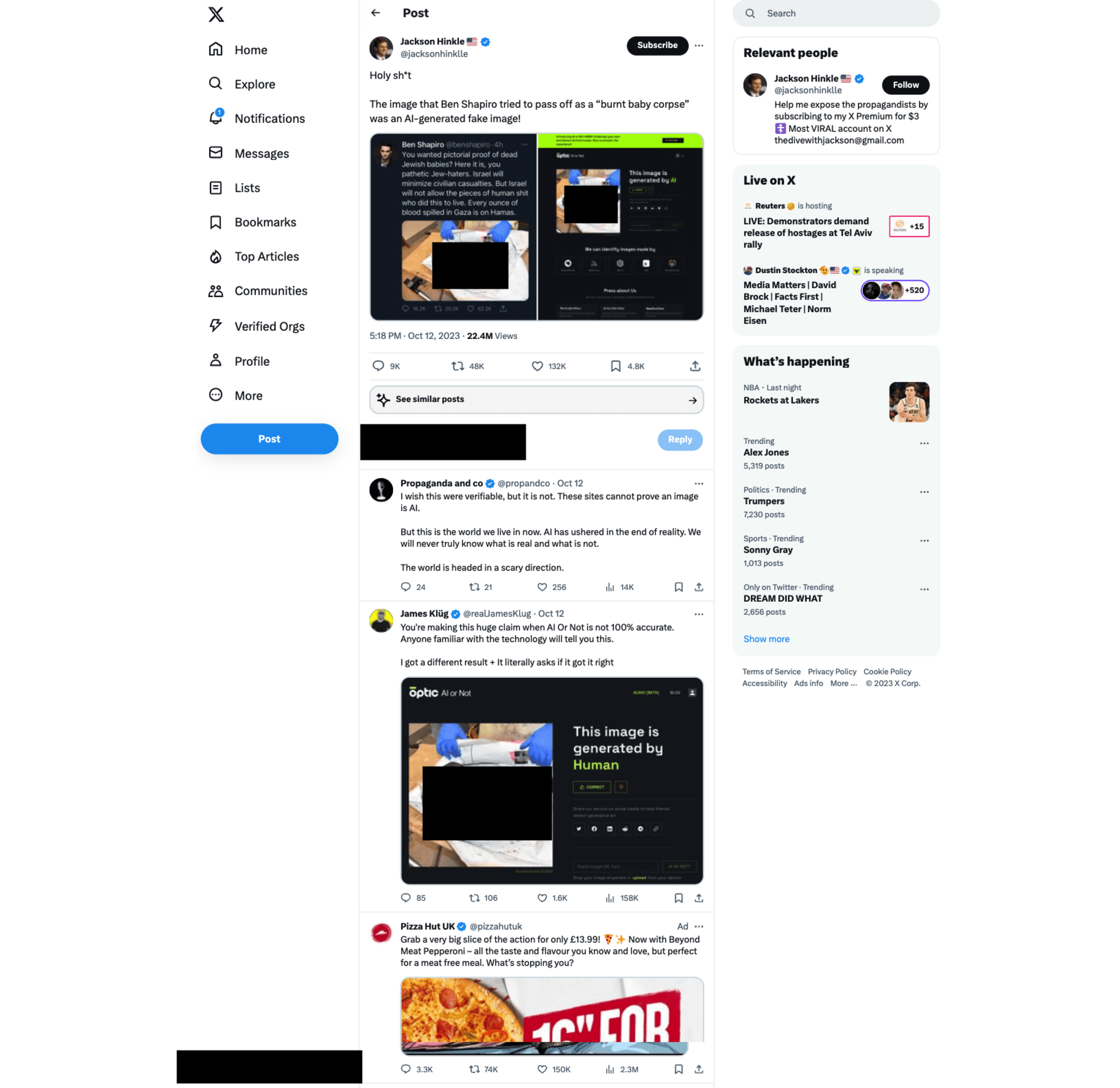

Par exemple, NewsGuard a trouvé 22 publicités pour de grandes organisations sur trois posts publiés par Jackson Hinkle qui relayaient de fausses affirmations sur la guerre et qui ne comportaient pas de note de la communauté. Jackson Hinkle est un commentateur qui se décrit comme un “marxiste-léniniste conservateur américain” et qui a diffusé des dizaines d’affirmations fausses et trompeuses sur la guerre, selon une analyse de NewsGuard.

Les analystes de NewsGuard ont été ciblés par des publicités pour Oracle, Pizza Hut et l’entreprise chinoise de produits électroniques Anker, entre autres, sous un post publié par Jackson Hinkle le 12 octobre 2023, qui relayait la fausse affirmation selon laquelle l’animateur du podcast Daily Wire, Ben Shapiro, avait utilisé l’intelligence artificielle pour générer l’image d’un enfant tué par le Hamas. Le post de Jackson Hinkle avait récolté 22 millions de vues au 20 novembre. Il faut cependant rappeler que la nature même de la publicité programmatique fait que les marques ignorent où leurs publicités apparaissent et qui elles soutiennent.

“Bon sang de bonsoir”, a déclaré Jackson Hinkle. “L’image que Ben Shapiro a essayé de faire passer pour un ‘cadavre de bébé brûlé’ était une fausse image générée par l’intelligence artificielle !” En réalité, rien ne prouve que la photo — qui à l’origine a été partagée par le gouvernement israélien — ait été générée par l’IA. Hany Farid, professeur à l’École d’Information de l’Université de Berkeley, en Californie, a déclaré au site d’actualité technologique 404 Media que l’image du bébé “ne présente aucun signe de création par l’IA”. Il a ajouté : “Les cohérences structurelles, les ombres précises, l’absence d’artefacts que nous avons tendance à voir dans l’IA — tout cela m’amène à penser qu’elle n’a pas été générée par l’IA, pas même partiellement. En date du 20 novembre, le post X ne comportait pas de note de la communauté, ce qui signifie que Jackson Hinkle était probablement éligible au partage des recettes publicitaires.

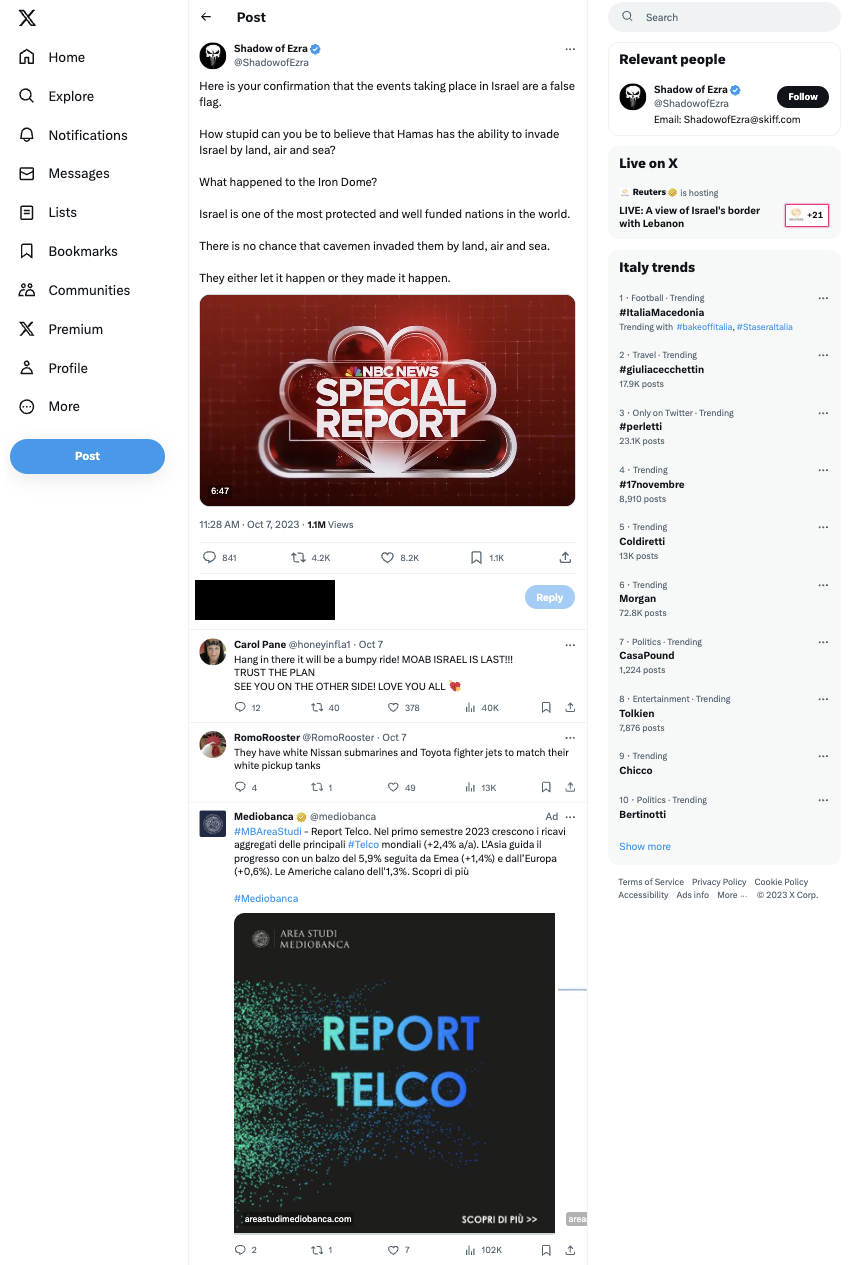

De même, NewsGuard a repéré des publicités pour 36 grands annonceurs (certaines organisations sont apparues plus d’une fois) sur trois posts publiés par le compte d’extrême droite @ShadowofEzra qui diffusaient des fausses informations sur la guerre. Aucun des trois posts ne comportait de note de la communauté.

Sur l’un de ces posts, qui relayait la théorie sans fondement selon laquelle l’attaque du 7 octobre 2023 contre Israël par le Hamas était un “faux drapeau”, les analystes de NewsGuard se sont vu présenter des publicités pour Paramount, Microsoft, la société de robotique ABB Robotics, la banque d’investissement italienne Mediobanca et la société de matières premières Sappi Group. “Voici la confirmation que les événements qui se déroulent en Israël sont un faux drapeau”, disait le post de @ShadowofEzra. “Comment pouvez-vous être aussi stupide pour croire que le Hamas a la capacité d’envahir Israël par la terre, par les airs et par la mer ? (…) Soit ils ont laissé faire, soit ils ont fait en sorte que cela se produise”. Le post avait été vu 1,1 million de fois au 21 novembre 2023. (Le 17 novembre, Paramount a déclaré qu’il cesserait de faire de la publicité sur X. La publicité de Paramount a été montrée à un analyste avant que le groupe fasse cette annonce).

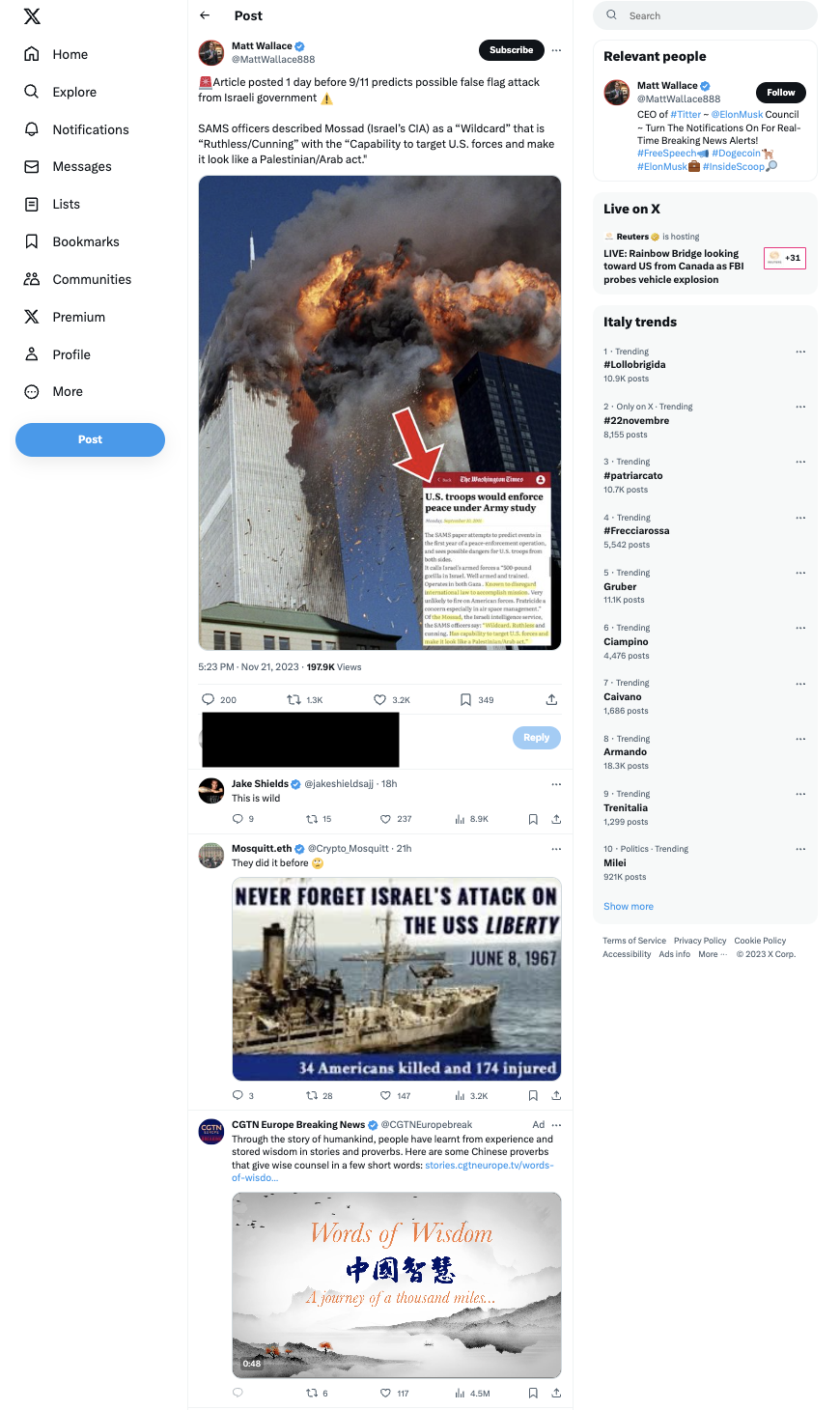

De même, des publicités pour Airbnb, le groupe Virgin, l’entreprise technologique taïwanaise Asus, l’entreprise médiatique conservatrice The Dispatch et l’entreprise suédoise d’hygiène Essity, qui pèse plusieurs milliards de dollars, sont apparues à côté d’un post du commentateur conservateur Matt Wallace, qui affirmait sans fondement que l’attaque du Hamas contre Israël était un “coup monté” d’Israël. L’article ne comportait pas de note de la communauté et avait cumulé 1,2 million de vues au 21 novembre.

Il convient de noter que pour bénéficier du partage des recettes publicitaires sur X, les titulaires de comptes doivent répondre à trois critères spécifiques : être abonnés à X Premium (pour 8 dollars par mois), avoir recueilli au moins cinq millions d’impressions organiques sur leurs posts au cours des trois derniers mois, et avoir un minimum de 500 followers. Chacun des dix comptes de “super-propagateurs” analysés par NewsGuard semble répondre à ces critères.

Quand gouvernements et ONG financent indirectement la mésinformation sur la guerre Israël-Hamas

Sur les 200 publicités identifiées par NewsGuard sur les posts des super-propagateurs contenant de la mésinformation sur la guerre, 26 étaient pour des organisations affiliées à des États, y compris des agences gouvernementales, des entreprises publiques et des médias étatiques étrangers.

Par exemple, NewsGuard a trouvé une publicité pour le FBI sur un post de Jackson Hinkle du 9 novembre 2023 qui prétendait qu’une vidéo montrait un hélicoptère de l’armée israélienne ouvrant le feu sur ses propres citoyens. Le post ne comportait pas de note de la communauté et avait été vu plus de 1,7 million de fois au 20 novembre.

“ISRAËL ADMET avoir tiré sur ses PROPRES CIVILS avec des HÉLICOPTÈRES D’ATTAQUE APACHE !” a écrit Jackson Hinkle dans un post en renvoyant vers la vidéo. En réalité, la vidéo montre des avions de l’armée de l’air israélienne menant des attaques contre le Hamas au-dessus de la bande de Gaza, selon GeoConfirmed, un collectif qui enquête sur les conflits à l’aide de sources ouvertes (“open source intelligence”, ou OSINT) et de techniques de géolocalisation.

La publicité du FBI apparue sous le post de Jackson Hinkle faisait la promotion du travail du FBI pour mettre fin aux crimes haineux. “Les crimes haineux ne font pas seulement du tort aux victimes, ils sèment aussi la peur dans leurs communautés”, disait la publicité. “Le #FBI s’engage à combattre les crimes de haine et à rendre justice aux victimes”. Le 20 novembre, NewsGuard a envoyé au FBI deux emails et un message par le biais d’un formulaire de contact pour savoir si l’annonce avait été placée à dessein. En réponse, un porte-parole du FBI n’a pas souhaité faire de commentaire et a renvoyé NewsGuard vers X pour toute question concernant le placement des publicités sur la plateforme.

Parmi les autres publicités émanant d’entités gouvernementales figurait une publicité pour la compagnie nationale Abu Dhabi National Oil sous un post prétendant (sans fondement) montrer un blogueur palestinien simulant des blessures de guerre ; une publicité du ministère taïwanais de la Culture sous un message prétendant à tort qu’une vidéo montrait Israël tirant sur ses propres civils ; et une publicité pour China Global Television Network (CGTN) — une chaîne de télévision publique chinoise — sous un post de Matt Wallace suggérant que le 11 septembre 2001 était une “attaque sous faux drapeau du gouvernement israélien”. Aucun de ces posts ne comportait de notes de la communauté à la date du 21 novembre.

NewsGuard a également trouvé des publicités pour une poignée d’organisations à but non lucratif et d’établissements d’enseignement sur des posts diffusant de fausses informations sur la guerre. Par exemple, NewsGuard a trouvé une publicité pour Clean Air Action Fund, une association consacrée à la réduction de la pollution de l’air, sur un post publié par @YosephHaddad qui affirmait à tort que des images de CNN montraient un “acteur de crise” palestinien entraîné pour jouer la victime. Le post, qui ne comportait pas de note communautaire, avait été vu plus de 639.000 fois au 21 novembre. (NewsGuard a également été ciblé par une publicité pour le Centre national danois du génome, une agence du ministère danois de la santé, sur le même post).

Une publicité pour l’Université de Baltimore, dans le Maryland (États-Unis), a été présentée à NewsGuard sur le post de Jackson Hinkle mentionné plus haut affirmant qu’une vidéo montrait Israël ouvrant le feu sur ses propres citoyens.

Un post publié par @ShadowofEzra affirmant que la guerre était un “faux drapeau” présentait une publicité pour la Royal Society of Chemistry, une société savante britannique à but non lucratif dont l’objectif est de “faire progresser les sciences chimiques”. Dans son post, @ShadowofEzra renvoyait vers une interview de CNN montrant le porte-parole du Conseil de sécurité nationale aux États-Unis, John Kirby, en train de s’émouvoir de l’attaque du Hamas contre Israël le 7 octobre 2023. “John Kirby se met à pleurer en direct sur CNN”, disait @ShadowofEzra. “Besoin d’une preuve supplémentaire qu’il s’agissait d’un faux drapeau ?”

Méthodologie

Entre le 13 et le 22 novembre 2023, NewsGuard a analysé 30 posts diffusant de la mésinformation sur la guerre, postés par 10 comptes préalablement identifiés par NewsGuard comme étant de “super-propagateurs” de mésinformation en lien avec la guerre entre Israël et le Hamas. NewsGuard a défini les “super-propagateurs” de mésinformation comme ceux qui ont diffusé au moins trois affirmations fausses ou manifestement trompeuses liées à la guerre, et qui ont plus de 100.000 abonnés sur X. Bon nombre de ces comptes ont diffusé bien plus que trois affirmations fausses ou manifestement trompeuses en lien avec la guerre.

Pour simuler l’expérience de la publicité programmatique de différents utilisateurs, NewsGuard a utilisé des réseaux privés virtuels (VPN) — un outil qui permet aux utilisateurs de naviguer sur internet comme s’ils se trouvaient dans un autre pays — et a rafraîchi à plusieurs reprises la page de chacun des 30 posts. Pour chaque post, NewsGuard a navigué aux États-Unis, au Royaume-Uni, en Allemagne, en France et en Italie et a actualisé la page 25 fois au maximum. NewsGuard a fait défiler la page pour “réinitialiser” le flux cinq fois au maximum, car toutes les réponses à un post donné ne s’affichent pas sur l’écran de ce post.

Lors de l’analyse de ces 10 comptes, les analystes ont recherché les publicités figurant dans la section “réponses” des messages contenant de la mésinformation sur la guerre. Les réponses — et les publicités qui figurent parmi celles-ci — sont affichées directement sous les posts. Les analystes ont réalisé des captures d’écran de chaque publicité.

X a récemment intenté un procès contre Media Matters for America pour un article que le groupe progressiste a publié au sujet des publicités de grandes marques apparaissant aux côtés de comptes véhiculant des contenus extrémistes. Dans cette affaire, X a allégué que Media Matters avait créé l’association de ces marques avec ce contenu en demandant aux comptes X qu’elle utilisait de ne suivre qu’une sélection de grandes marques d’une part, et qu’une sélection de comptes à contenu extrémiste d’autre part, créant ainsi ce que X appelle un scénario “inorganique” dans lequel les publicités de ces marques apparaîtraient à côté de ce contenu, produisant ainsi “des images accolées de manière artificielle et malveillante”.

Sans spéculer sur la véracité de ces allégations, il convient de noter que la méthodologie de NewsGuard était différente de celle utilisée, selon X, par Media Matters for America :

- NewsGuard n’a pas manipulé l’échantillon en suivant sélectivement certaines marques ou certains comptes. Les analystes de NewsGuard ont examiné le contenu viral qui se produisait naturellement sur la plateforme et qui leur a été présenté sur leurs propres comptes X personnels.

- Les posts analysés par Media Matters for America ont reçu relativement peu d’impressions. Comme indiqué ci-dessus, les 30 posts analysés par NewsGuard ont cumulé au total plus de 92 millions de vues, selon les données de X. En moyenne, chaque post a été vu 3 millions de fois.

- NewsGuard a plafonné le nombre de fois où il a rafraîchi chaque post dans chaque pays analysé (25 fois), et a fait défiler le flux (cinq fois). (X n’affiche qu’un nombre limité de réponses à un post dans un flux donné).