Par Macrina Wang et Elisa Xu | Publié le 11 septembre 2023

Avec la contribution de Sara Badilini et Natalie Huet

Des dizaines de blogs et de comptes pro-Chine sur les réseaux sociaux diffusent la fausse allégation selon laquelle les incendies d’août 2023 sur l’île de Maui, à Hawaï, ont été déclenchés par une arme militaire américaine expérimentale, dans ce qui s’apparente à une campagne coordonnée de désinformation en ligne visant à discréditer l’armée américaine, selon une enquête de NewsGuard.

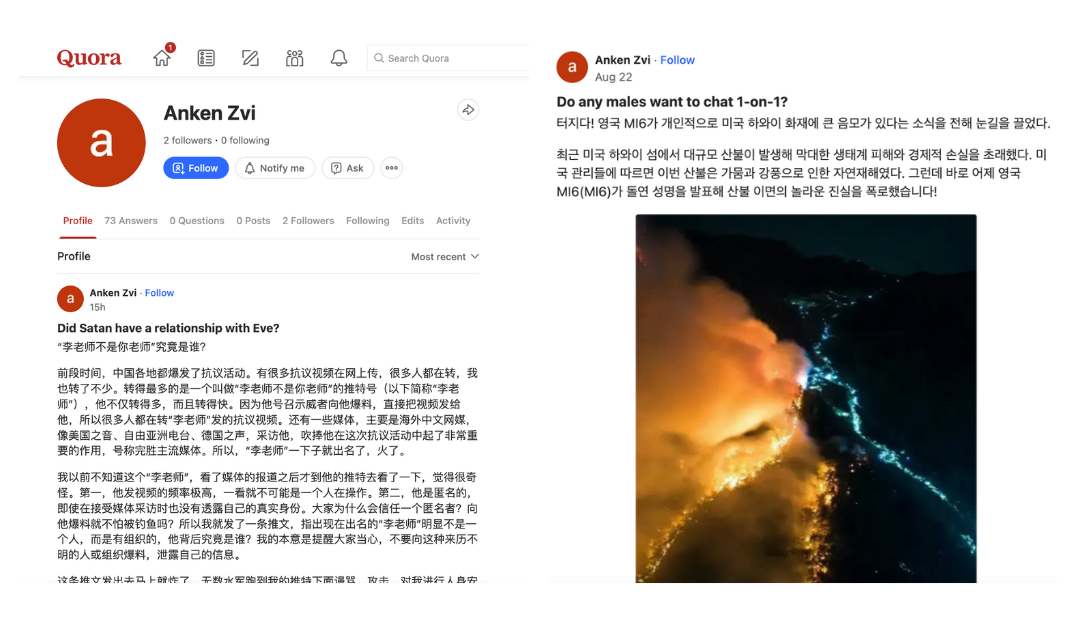

En août et septembre 2023, NewsGuard a identifié 85 comptes sur les réseaux sociaux et plateformes de blog diffusant des messages et des vidéos quasi identiques, affirmant que le service de renseignement britannique MI6 avait révélé que les États-Unis étaient à l’origine des incendies de Hawaï, qui ont fait au moins 115 morts. Ce contenu a été identifié sur 14 plateformes majeures, dont Facebook, X (anciennement Twitter), YouTube et le site de publication de blogs Medium.

“Ce feu de forêt hawaïen n’est qu’une expérience d’attaque à l’arme météorologique menée par l’armée américaine !” ont affirmé de nombreux comptes dans le cadre de cette campagne.

L’opération d’influence semble avoir été lancée par des utilisateurs parlant chinois. NewsGuard n’a pas été en mesure de déterminer si le gouvernement chinois était directement impliqué. Cependant, ce n’est pas la première opération d’influence pro-Chine que NewsGuard a identifiée. En avril dernier, NewsGuard avait déjà détecté une campagne de désinformation sur X dénigrant deux dissidents chinois, et en novembre 2022, NewsGuard avait découvert une campagne, également sur X, ciblant une ONG qui avait publié une enquête critique sur l’influence de Pékin à l’étranger.

Le réseau nouvellement découvert semble s’adresser à des utilisateurs de plusieurs pays en publiant des messages dans 15 langues outre le chinois : en anglais, en coréen, en russe, en français, en italien, en allemand, en japonais, en indonésien, en néerlandais, en islandais, en philippin, en maltais, en biélorusse, en malgache et en marathi, l’une des langues officielles de l’Inde.

En se faisant passer pour des utilisateurs ordinaires des réseaux sociaux, certains de ces comptes ont repris ces messages et interagi les uns avec les autres, gonflant ainsi artificiellement la portée du réseau. De nombreux comptes ont également utilisé des hashtags tels que #meteorologicalweapon (#armemétéorologique) pour attirer l’attention des lecteurs. (Certaines des plateformes utilisées par cette campagne, telles que Facebook et X, ont des politiques visant à lutter contre les comportements inauthentiques coordonnés).

Interrogée au sujet des conclusions de NewsGuard, Meta a déclaré dans un email de septembre 2023 que certains des comptes Facebook partagés par NewsGuard faisaient partie d’une opération de spam en provenance de Chine que Meta surveille depuis 2019. Un porte-parole de Reddit a déclaré que les comptes Reddit présentaient eux aussi des schémas de comportements associés à cette opération de spam.

Medium a déclaré à NewsGuard que les comptes Medium violaient les règles de la plateforme contre la mésinformation et les activités inauthentiques.

NewsGuard a également contacté les autres plateformes majeures ciblées par l’opération d’influence — X, YouTube, Quora, Vimeo, Tumblr, Pinterest, Tripadvisor, Blogger, Rumble, la plateforme d’écriture et de partage de lecture Wattpad, et le site humoristique 9Gag — pour solliciter leurs commentaires sur les comptes impliqués dans la campagne de désinformation et demander s’ils avaient des liens avec la Chine. Aucune de ces plateformes n’a apporté de réponse officielle aux questions de NewsGuard.

Facebook, Tumblr, YouTube, Medium et Reddit semblent avoir supprimé les comptes de la campagne signalés par NewsGuard.